Transformer архитектур гэж юу вэ?

Transformer архитектур нь янз бүрийн салбарт, ялангуяа эх хэл боловсруулалтад (NLP)

ихээхэн ахиц дэвшил авчирсан машин сургалтын фреймворк юм. 2017 онд архитектурын

тухайн дэлгэрэнгүй мэдээлэл "Attention is

All You Need" гэсэн

нийтлэл дээр гарсан.

Давтамжит нейрал сүлжээ (RNN) гэх мэт уламжлалт загваруудаас ялгаатай нь Transformer архитектур нь өгүүлбэр дэх үгсийн хоорондын хамаарлыг олж мэдэхийн тулд анхаарлын механизмыг ашигладаг бөгөөд энэ нь зэрэгцээ боловсруулалт хийн, гүн нейрал сүлжээг илүү үр дүнтэй сургах боломжийг олгодог.

Transformer архитектур нь яаж ажилдаг вэ?

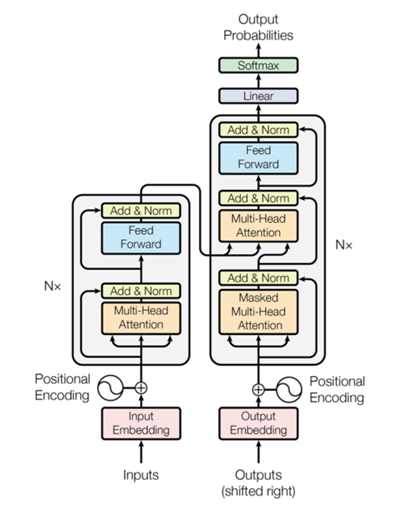

Transformer архитектур нь Encoder ба Decoder гэсэн хоёр үндсэн компонент хэсгээс бүрдэнэ. Encoder болон Decoder нь олон давхаргаас бүрдэх бөгөөд тус бүр нь өөртөө анхаарлын механизм, дамжуулагч нейрал сүлжээг агуулсан байдаг. Encoder нь оролтын дарааллыг боловсруулж, мэдээллийг Encoder-ийн далд төлөв гэж нэрлэгддэг дүрслэлийн багц болгон кодчилдог. Decoder нь Encoder ийн далд төлөвийг хүлээн авч, анхаарлын механизмын тусламжтай оролтын дарааллын холбогдох хэсгийг боловсруулахдаа гаралтын дарааллыг үүсгэдэг. Анхаарлын механизм нь архитектур дотор боловсруулагдаж байгаа үгийг бусад үгтэй холбож, утга зүйн талаас тооцоолдог бөгөөд контекст мэдээллийн талаарх ойлголтыг сайжруулдаг.

Transformer

архитектур яагаад чухал вэ?

Transformer архитектур нь уламжлалт загваруудын зарим

хязгаарлалтыг шийдэж, эх

хэл боловсруулалтын салбарт хувьсгал хийсэн.

Үүний гол давуу талууд нь:

Зэрэгцээ

боловсруулалт: Transformer

загварууд нь үгсийг зэрэгцүүлэн боловсруулж, RNN

гэх мэт дараалсан загваруудтай харьцуулахад илүү хурдан суралцаж, дүгнэлт

гаргах боломжийг олгодог.

·

Урт хугацааны

хамаарал: Анхаарлын механизм нь загварт оролтын

дарааллаар хол байгаа үгсийн хоорондын хамаарлыг олж авах боломжийг олгодог

бөгөөд контекстийн ойлголтыг сайжруулдаг.

·

Өргөтгөх чадвар: Загварууд нь хувьсах

урттай оролтын дарааллыг дүүргэх

шаардлагагүйгээр боловсруулж, урт баримт бичиг эсвэл харилцан

яриатай холбоотой ажлуудад тохиромжтой болгодог.

· Дамжуулах сургалт:

BERT болон GPT зэрэг урьдчилан суралцсан Transformer загварууд

нь асар их хэмжээний өгөгдөл дээр сургагдсан бөгөөд тодорхой даалгавруудад зориулж ашиглавал, цаг

хугацаа болон

нөөцийг хэмнэдэг.

Трансформаторын

архитектурын хэрэглээ:

·

Эх

хэл боловсруулалт (NLP): Transformer загварууд машин орчуулга, мэдрэмжид дүн шинжилгээ хийх, асуултад

хариулах, текст үүсгэх, нэрлэсэн объектыг таних зэрэг ажлуудад сайн үр дүнд

хүрсэн.

· Яриа таних: Transformer суурилсан загварууд нь яриа таних даалгавруудад гайхалтай үр дүнгүүд үзүүлж, нарийвчлалтай transcription болон дуу хоолойгоор удирддаг системийг бий болгосон.

Мэдээ бэлтгэсэн: Мэдээллийн технологийн салбарын ЭША Б.Номуундалай